在我年纪很小的时候,就想过,如果有一天,有机器人帮我写语文作文,就好了,最好是写的比较 “像人话”。

可是当我发现,真的有AI能写文章后,我已经过了需要写作文的年纪。

今天给大家分享的就是一款可以帮你自动写文章的AI。

他的名字叫做 GPT-2,我们来感受一下,网址为:https://demo.allennlp.org/next-token-lm?text=AllenNLP%20is

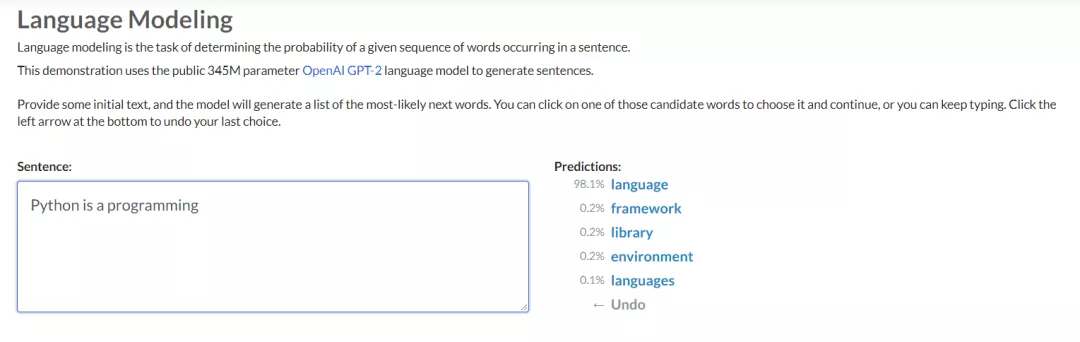

在这个网站中,我们随意输入一段文字作为开头(最好是英文),然后在网站中,它会帮你补全下一个单词,为了更加多样化,它会给出之后更可能出现的几个单词,并以分数值表示出现的可能性。

如下图,我们输入: Python is a programming之后,右边会提示98.1%的可能性下一个词是language! 你可能会说,这不就是现在使用的输入法么!

你可能会说,这不就是现在使用的输入法么!

先别把手铐递过来,听我说完啊,当我们输入一小段文字之后,我们可以取最高概率的下一个词作为下一个词,然后不断这样,就能生成很长的文本啦!

我们看 GPT-2 官方给出的一个例子:

用户输入的文字是:

用户输入的文字是:

在一个令人震惊的发现中,科学家发现了一群独角兽,它们生活在安第斯山脉一个偏远的,以前未被开发的山谷中。令研究人员更加惊讶的是,独角兽会说完美的英语。

GPT-2 自动生成的接下来文字是:

这位科学家以其独特的号角,奥维德的独角兽命名了这个种群。这些四角银白色独角兽以前是科学界所不知道的。现在,在将近两个世纪之后,终于解决了引发这种奇怪现象的谜团。拉巴斯大学的进化生物学家豪尔赫·佩雷斯(JorgePérez)博士和几位同伴在安第斯山脉发现一个没有其他动物或人类的小山谷时正在探索。佩雷斯注意到该山谷似乎是一个天然喷泉,周围环绕着两个岩石和银色雪峰。佩雷斯和其他人然后冒险进入山谷。佩雷斯说:“当我们到达一个山峰的顶部时,水看起来是蓝色的,上面有一些晶体。”佩雷斯和他的朋友们惊讶地看到了独角兽群。可以从空中看到这些生物,而不必动太多就可以看到它们-它们是如此接近以至于可以触摸它们的角。在检查这些怪异生物时,科学家发现这些生物也讲一些相当普通的英语。佩雷斯说:“例如,我们可以看到他们有共同的'语言',例如方言或辩证法。”佩雷斯博士认为,独角兽可能起源于阿根廷,在那里人们相信这些动物是在人类到达南美洲这些地区之前居住在那里的一群迷失人口的后代。虽然其起源尚不清楚,但有人认为,也许这些生物是人类和独角兽在人类文明诞生之前相遇时创造的。佩雷斯说:“在南美,这类事件似乎很普遍。”但是,佩雷斯还指出,要确定独角兽是否确实是迷失的外来种族的后裔,唯一的可能途径就是通过脱氧核糖核酸。这位科学家说:“但是他们似乎能够用英语很好地交流,我相信这是进化的迹象,或者至少是社会组织的变化。”

当我第一次知道这个的时候,我的感觉是:

带大家揭开这个GPT-2神秘的面纱!在论文《Language Models are Unsupervised Multitask Learners》中,GPT-2被OpenAI提出,说起GPT-2,你可能还记得我们上次提到的GPT,没错,你可以认为GPT-2是GPT的升级版!

GPT是在BERT之前发布的,但是发布GPT的团队不太会包装宣传,而BERT之后也很快发布了,大家的关注点都在BERT上,导致GPT没什么热度,GPT-2似乎是为了给GPT“报仇”,一发布就引起了轰动!(不过,悄咪咪的说一句,还是BERT香!)

GPT-2在GPT的基础上,有以下几个大变化:

1. 使用的训练数据更多更高质量更宽泛

找了800万互联网网页作为语言模型的训练数据,在论文中称为WebText,网页中的内容宽泛,训练的模型通用性好,这数据大概有40GB。

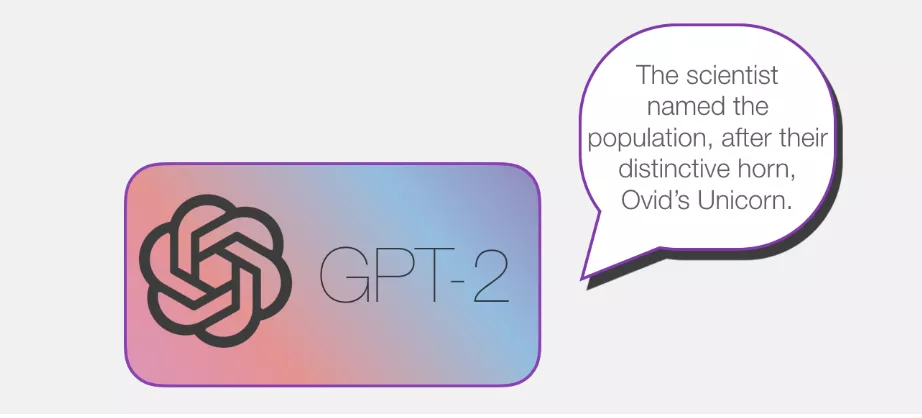

2.使用的模型参数更多

GPT-2训练了四种不同大小的模型:

其中,BERT和MEDIUM的GPT-2大小相似。

其中,BERT和MEDIUM的GPT-2大小相似。

在之前,我们讲到GPT是单向的,而BERT是双向的,GPT-2依然维持GPT单向的特点,似乎是要证明即使是单向的,我参数多,训练数据量大,也不比双向的差!

数据量大,模型参数多,其实就是烧钱!

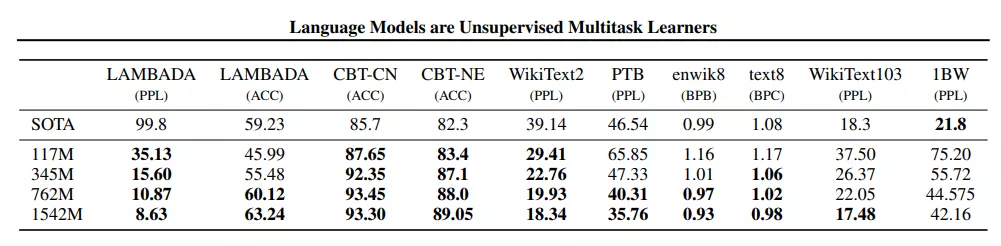

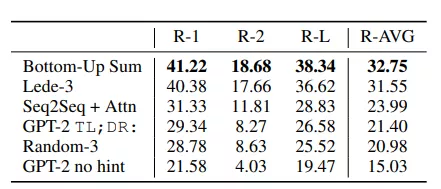

作者直接将这个通过大量数据预训练的模型,不微调的跑了各个下游的NLP任务:

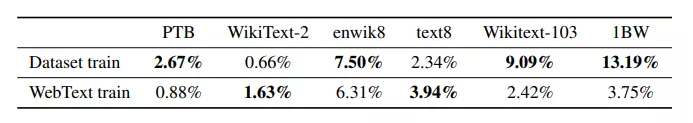

作者还给出了不同数据集的训练集和测试集中数据重合度情况,而GPT-2是在去除重合的数据集上训练测试的,所以更突出GPT-2的效果好!

试想一下,如果是BERT有GPT-2最大参数量模型的大小,配合BERT的真正双向,通过预训练+微调的方法,效果应该是很好的!

参考文献:

1.https://d4mucfpksywv.cloudfront.net/better-language-models/language_models_are_unsupervised_multitask_learners.pdf

2. https://jalammar.github.io/illustrated-gpt2/

扫码下图关注我们不会让你失望!